La Inteligencia Artificial (IA) vuelve a ofrecer promesas recicladas sobre la personalización del aprendizaje y el aprendizaje adaptativo, generando más preguntas que respuestas sobre su integración. Para personalizar el aprendizaje, ¿qué datos son realmente necesarios y qué variables debemos considerar en cada momento del proceso educativo?

Aunque la IA permite adaptar contenidos y estrategias a las necesidades de los estudiantes, la cuestión no puede reducirse a una simple adopción tecnológica. La capacidad de procesar grandes volúmenes de datos y ajustar recomendaciones en tiempo real no resuelve, por sí sola, el problema central: determinar qué significa realmente personalizar y bajo qué criterios pedagógicos debe hacerse.

Lo que no sabemos

La tecnología de IA ha alcanzado un nivel de desarrollo que le permite gestionar grandes volúmenes de datos y generar recomendaciones personalizadas en tiempo real. Sin embargo, esta capacidad técnica no equivale a disponer de evidencia pedagógica sólida sobre cómo optimizar la personalización del aprendizaje en contextos educativos complejos.

Carecemos todavía de información rigurosa que permita determinar cuáles son las estrategias más eficientes y seguras para superar la rigidez del modelo único impuesto por el sistema educativo tradicional.

Este modelo parte de la premisa de que la mayoría de los estudiantes deben seguir la misma secuencia de aprendizaje, como si todos compartieran los mismos conocimientos previos, intereses, metas y necesidades.

En 2019, antes del auge de la Inteligencia Artificial Generativa (IAGen) impulsada por grandes modelos de lenguaje como ChatGPT de OpenAI, Olaf Zawacki-Richter, profesor alemán de tecnología educativa en la Universidad de Oldenburg, junto a sus colaboradores, señaló en un estudio que la participación de los profesionales de la educación en el uso de la IA era limitada y que existía un descuido notable de los aspectos pedagógicos y éticos en su implementación.

Cinco años después, el autor, esta vez con nuevos colaboradores, llegó a conclusiones similares. La diferencia más significativa fue el crecimiento exponencial del número de estudios, que se había multiplicado por ocho en este periodo. Sin embargo, estas investigaciones seguían centrándose en evaluar las capacidades técnicas de las herramientas y sus impactos potenciales, dejando nuevamente en segundo plano los enfoques pedagógicos y éticos.

Aunque las investigaciones sobre el uso de la IAGen en educación continúan creciendo, todavía no contamos con una base científica suficientemente robusta que respalde con seguridad la toma de decisiones para su integración educativa.

La mayor parte de estos estudios se concentra en la educación superior, mientras que la educación primaria ha recibido significativamente menos atención. Según una revisión, esta brecha podría explicarse por limitaciones de infraestructura, problemas de accesibilidad, falta de contenidos adecuados para edades tempranas y retrasos en los procesos de implementación.

Esto no implica abandonar la exploración de las mejoras que la IAGen puede ofrecer a la enseñanza y al aprendizaje. Implica, más bien, reconocer que estamos introduciendo estas tecnologías en contextos reales y no siempre controlados, impulsados por su potencial técnico y por promesas como la personalización del aprendizaje, sin disponer todavía de un respaldo pedagógico equivalente.

No toda vale, tengamos paciencia

En los estudios que analizamos en 2024, uno de los temas más recurrentes es el análisis de los desafíos éticos que plantea la integración de la IA.

Abordar los retos pedagógicos y técnicos desde una perspectiva centrada en las personas se ha convertido en una preocupación compartida entre profesionales de la educación, tecnólogos, responsables políticos, filósofos y sociólogos.

Esto enfatiza la necesidad de un uso responsable de las herramientas de IA, respetando principios de integridad académica y atendiendo aspectos clave como la privacidad de los datos, la fiabilidad, la transparencia y los derechos de autor.

Oscar Cordón señaló en 2023 que la evolución de la IA requiere la implementación de marcos legales que garanticen un uso ético, equitativo, inclusivo, confiable y seguro. Para lograrlo, resulta imprescindible que la sociedad comprenda tanto los beneficios como las limitaciones de estas herramientas.

Estamos ante un cambio significativo que nos lleva a convivir con sistemas inteligentes capaces de apoyar la toma de decisiones y la automatización de tareas.

El desarrollo de estándares y marcos éticos para integrar la IA en entornos de aprendizaje personalizados debe ocupar un lugar prioritario en la investigación. Esto implica atender cuestiones como el sesgo algorítmico, la protección de la privacidad y la transparencia en los procesos de decisión.

En este contexto, las instituciones educativas tienen la responsabilidad de establecer marcos claros, promover la concienciación y garantizar la formación adecuada del profesorado. Una vez formados (lo cual ya supone un reto considerable), los docentes pueden guiar a los estudiantes hacia un uso responsable y crítico de la IA, siguiendo recomendaciones como las propuestas por Mariona Grane:

- Definir reglas conjuntas con el alumnado.

- Diseñar entornos controlados para explorar el uso de la IA.

- Incentivar el cuestionamiento de las respuestas y decisiones de la IA.

- Proporcionar estrategias para verificar la información y las fuentes.

- Crear espacios para reflexionar críticamente sobre los datos obtenidos.

La gran promesa reciclada de la personalización del aprendizaje con IA

La personalización del aprendizaje es una de las oportunidades más destacadas que la IA puede ofrecer en el ámbito educativo, junto con la mejora de los procesos de evaluación en entornos digitales. Este concepto se refiere a la capacidad de adaptar objetivos, intereses y competencias mediante ajustes continuos que responden a los cambios en el rendimiento y el contexto del estudiante.

En teoría, permitiría que cada aprendiz avance a través de itinerarios ajustados a sus conocimientos previos, preferencias y metas individuales.

Entre las herramientas más prometedoras para lograrlo se encuentran los tutores y agentes inteligentes. Estos sistemas, basados en algoritmos avanzados y análisis de datos, ajustan de manera continua el contenido, el nivel de dificultad y los recursos en función de las interacciones del estudiante. En los últimos años han evolucionado desde simples mecanismos de retroalimentación hacia entornos de aprendizaje sofisticados con capacidad para diseñar rutas personalizadas.

Sin embargo, los métodos actuales para la toma de decisiones en estas rutas presentan limitaciones relevantes, especialmente en la capacidad de predecir con precisión la dificultad de los puntos de conocimiento. Además, la falta de empatía humana y apoyo emocional continúa siendo una de las principales preocupaciones en el uso de tutores basados en IA.

Aunque estos sistemas pueden resultar eficaces en la adaptación técnica del contenido, no replican las dimensiones relacionales y emocionales propias de la tutoría humana.

La cuestión, por tanto, no es únicamente si estos sistemas pueden personalizar el aprendizaje desde el punto de vista técnico, sino bajo qué criterios se diseñan esas rutas, qué variables se priorizan y quién asume la responsabilidad última de las decisiones que orientan el proceso formativo.

De agente único a la arquitectura multi-agente

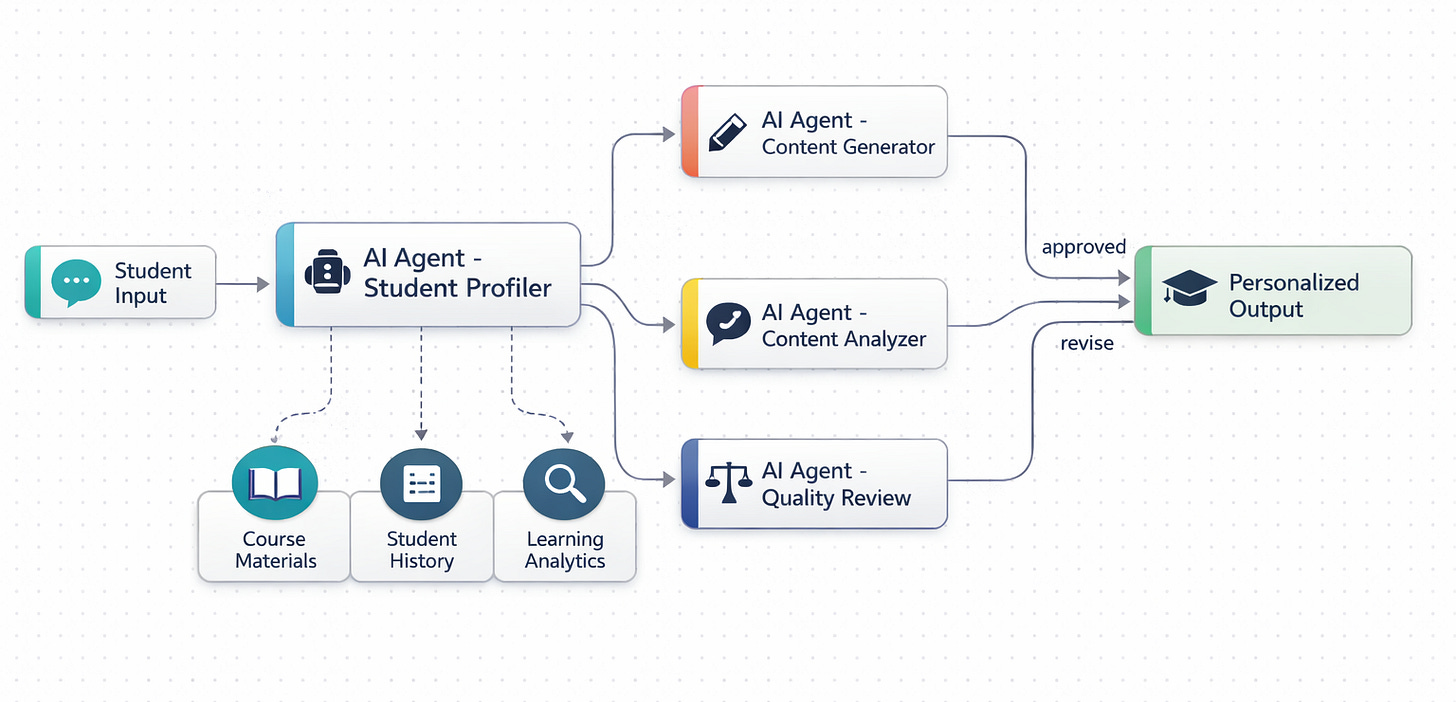

Durante años, la personalización del aprendizaje basada en IA se ha articulado en torno a un modelo relativamente simple: un agente que analiza datos, ajusta contenidos y ofrece retroalimentación. Sin embargo, la evolución reciente apunta hacia arquitecturas más complejas compuestas por múltiples agentes especializados que interactúan entre sí.

Ya no se trata únicamente de un sistema que responde, sino de un conjunto de módulos que diagnostican, generan propuestas, verifican resultados y reajustan itinerarios.

Herramientas de automatización como N8N o plataformas similares ya permiten orquestar flujos de trabajo en los que varios agentes basados en IAGen se conectan y asumen funciones diferenciadas: uno puede analizar las respuestas del estudiante, otro generar retroalimentación adaptada, un tercero contrastar la coherencia de esa retroalimentación con los criterios de evaluación establecidos. Estos agentes pueden incluso dialogar entre sí antes de producir un resultado final.

En este escenario, el rol humano se desplaza. El docente deja de ser únicamente usuario o intérprete de recomendaciones para convertirse en diseñador de la arquitectura que organiza esas decisiones. No solo interactúa con una herramienta, sino que define cómo se distribuyen funciones, qué agente propone, cuál valida y bajo qué reglas se produce la iteración.

La cuestión ya no es solo si la IA decide, sino quién diseña el sistema que decide

Este cambio amplifica tanto el potencial como la responsabilidad. Una arquitectura multi-agente puede aumentar la sofisticación técnica del proceso adaptativo, pero también puede diluir la implicación directa del docente en tareas de diagnóstico, revisión o ajuste.

Cuando generación, evaluación y validación pueden distribuirse entre distintos agentes, el riesgo no es únicamente delegar tareas, sino delegar procesos metacognitivos completos.

La implementación práctica de asistentes basados en IAGen revela además un elemento poco discutido: su diseño exige un proceso iterativo continuo y genera una sensación de obsolescencia permanente. La actualización de modelos, la variabilidad en las respuestas y la necesidad de ajustar rúbricas o parámetros cuestionan la idea de estabilidad evaluativa que a veces se presupone en la tecnología.

Paradójicamente, exigimos a la IA una consistencia que tampoco garantizan los evaluadores humanos.

En este contexto, la sofisticación técnica no elimina la pregunta inicial, sino que la intensifica:

- ¿Bajo qué criterios se configuran estas arquitecturas?

- ¿Qué variables se priorizan?

- ¿Qué dimensiones quedan fuera?

- ¿Quién asume la responsabilidad última cuando el sistema orienta las decisiones formativas?

Cuando la arquitectura del sistema asume funciones de diagnóstico, ajuste y validación, la cuestión deja de ser únicamente tecnológica y se convierte en cognitiva.

No solo importa qué puede hacer la IA, sino qué dejamos de hacer nosotros cuando el sistema lo hace por nosotros.

Mentalidad sedentaria

Además de analizar quién diseña y quién decide, es necesario reflexionar sobre qué procesos cognitivos pueden verse erosionados cuando la personalización del aprendizaje se automatiza de forma creciente.

La dependencia excesiva de estas tecnologías puede limitar la creatividad, fomentar la pereza intelectual y conducir al sedentarismo cognitivo, entendido como una falta prolongada de esfuerzo mental que compromete el desarrollo de habilidades críticas.

Un estudio de 2024 señala que los estudiantes universitarios con altas expectativas académicas y buenos resultados tienden a depender más de herramientas basadas en IA. Esta dependencia puede asociarse con una menor disposición al análisis crítico y una mayor aceptación acrítica de la información generada por la tecnología.

El problema no es el uso puntual de la herramienta, sino la progresiva sustitución del esfuerzo cognitivo por delegación sistemática.

Si la IA facilita avanzar más rápido, pero reduce la necesidad de cuestionar, contrastar o elaborar de manera autónoma, el riesgo no es solo metodológico, sino formativo. Aprender implica enfrentarse a la dificultad, sostener la incertidumbre y realizar operaciones mentales que no siempre resultan cómodas.

Cuando la personalización se orienta exclusivamente a optimizar el rendimiento inmediato, puede terminar debilitando precisamente las capacidades que pretende potenciar.

El desafío, por tanto, no consiste en impedir el uso de la IA, sino en decidir qué tareas deben seguir siendo cognitivamente exigentes para el estudiante y cuáles pueden ser legítimamente asistidas. Y en esa decisión, el propio estudiante no puede quedar al margen.

Si la personalización se diseña exclusivamente desde el sistema o desde el docente, se corre el riesgo de sustituir una rigidez, la del modelo único, por otra: la del algoritmo. La agencia del estudiante, entendida no como capacidad aislada sino como práctica situada y mediada por los entornos en los que aprende, es también una condición para que el aprendizaje siga siendo formativo y no meramente adaptativo.

La automatización no es neutra: reconfigura el tipo de esfuerzo que se realiza y, con ello, el tipo de aprendizaje que se consolida.

Desconfiar del efecto “palabra de máquina”

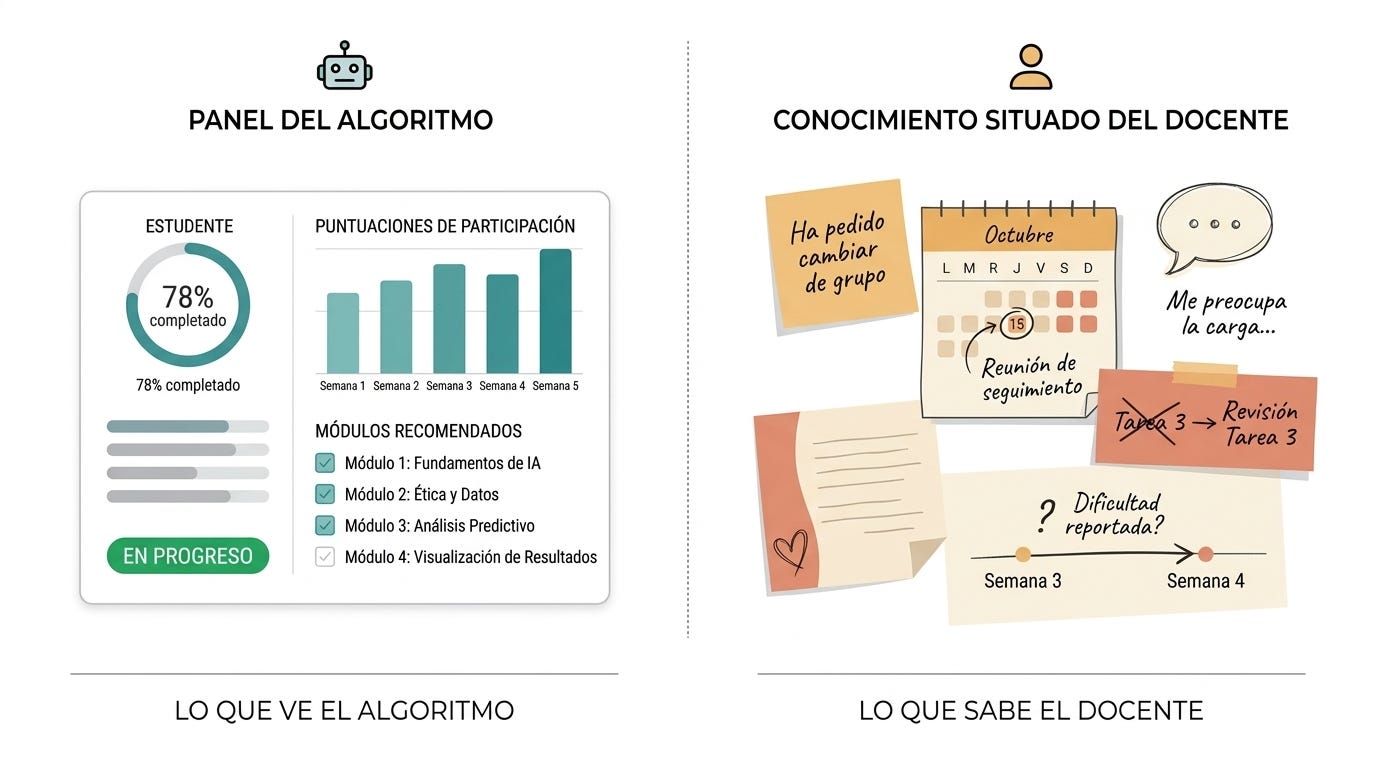

El avance de los sistemas adaptativos y de las arquitecturas multi-agente puede reforzar una percepción peligrosa: la idea de que las decisiones automatizadas son más objetivas, más eficientes y, por tanto, más fiables que las humanas.

Este fenómeno, que podríamos denominar “efecto palabra de máquina”, se apoya en la apariencia de neutralidad matemática y en la capacidad de procesar volúmenes de información que superan nuestras limitaciones cognitivas.

Sin embargo, como advierten Ujué Agudo y Karlos Liberal en El Algoritmo Paternalista, la automatización de decisiones no elimina los sesgos ni garantiza justicia o pertinencia pedagógica. Los algoritmos operan bajo supuestos, prioridades y modelos definidos por personas.

La aparente racionalidad algorítmica puede ocultar elecciones previas sobre qué variables considerar, qué resultados optimizar y qué dimensiones ignorar.

En este contexto, las pequeñas variaciones que pueden aparecer cuando un sistema automatizado evalúa un mismo trabajo en más de una ocasión no deben interpretarse como una anomalía técnica aislada, sino como un recordatorio de que la evaluación nunca es completamente estable ni puramente objetiva.

Tampoco lo es cuando la realiza un docente. Exigir a la IA una consistencia absoluta que no exigimos a los evaluadores humanos puede llevarnos a confundir precisión estadística con justicia pedagógica.

El riesgo no reside únicamente en que la tecnología cometa errores, sino en que aceptemos sus recomendaciones sin cuestionarlas. Cuando las predicciones y sugerencias automatizadas se convierten en la referencia principal para orientar decisiones educativas, el criterio profesional puede desplazarse progresivamente hacia una lógica de validación técnica.

El docente deja de decidir para empezar a confirmar.

Desconfiar del efecto “palabra de máquina” no implica rechazar la tecnología, sino resistirse a atribuirle una autoridad que no le corresponde. Lo que los sistemas adaptativos no pueden replicar no es solo la calidez humana, sino algo más específico: el conocimiento longitudinal del alumno.

Un docente acumula información que ningún modelo puede capturar en sus parámetros: la conversación de hace tres semanas, el cambio de actitud tras un conflicto personal, la diferencia entre un error conceptual y un mal día. Ese conocimiento situado, construido en el tiempo y en la relación, es precisamente lo que convierte la personalización en un acto pedagógico y no en una operación estadística.

La integración de la IA en educación no es, por tanto, un problema de capacidad tecnológica, sino de responsabilidad pedagógica.

Personalizar no es optimizar variables, sino ejercer criterio. Un criterio que surge del bagaje profesional del docente y de su conocimiento del alumno, y que no puede ser automatizado sin alterar el sentido mismo de la educación.

Autoría del artículo: José Luis Serrano y Juan Moreno